L'incubo dell'"Hellscape": quando le macchine decidono chi deve morire

Ottant'anni dopo che la guerra totale ha devastato l'Europa, il continente sta scommettendo su una nuova generazione di strumenti di annientamento. Il progetto ASGARD, recentemente testato nel Regno Unito, rappresenta quello che i militari chiamano eufemisticamente una "rete di ingaggio": droni autonomi, sistemi di intelligenza artificiale e armi coordinate che possono identificare, selezionare e colpire obiettivi in meno di sessanta secondi, senza intervento umano.

Ottant'anni dopo che la guerra totale ha devastato l'Europa, il continente sta scommettendo su una nuova generazione di strumenti di annientamento. Il progetto ASGARD, recentemente testato nel Regno Unito, rappresenta quello che i militari chiamano eufemisticamente una "rete di ingaggio": droni autonomi, sistemi di intelligenza artificiale e armi coordinate che possono identificare, selezionare e colpire obiettivi in meno di sessanta secondi, senza intervento umano.

L'obiettivo dichiarato è una "forza letale ad effetto deterrente", come ha spiegato Simon Brünjes, vicepresidente di Helsing, azienda produttrice di sistemi bellici AI, a DefenseTech 2024. Tradotto in termini più crudi: dimostrare a potenziali aggressori che l'Europa è capace, se provocata, di scatenare l'inferno. La Marina statunitense sta sviluppando capacità simili per Taiwan, con sciami di droni autonomi che si abbatterebbero sulle navi cinesi in ondate coordinate. Gli ammiragli hanno coniato un termine per descrivere il risultato di questi attacchi: "hellscape", paesaggio infernale.

La corsa verso l'abisso

I numeri sono sconcertanti. L'Ucraina ha aumentato la produzione di droni da 2,2 milioni nel 2024 a 4,5 milioni nel 2025. Il commissario UE per la difesa Andrius Kubilius stima che in caso di guerra più ampia con la Russia, l'Unione Europea avrà bisogno di tre milioni di droni all'anno solo per difendere la Lituania, un paese di appena 2,9 milioni di abitanti. Progetti come ASGARD moltiplicano queste cifre esponenziali con l'altra variabile chiave della guerra: la velocità. La catena di uccisione automatizzata promette di rendere l'esercito britannico "dieci volte più letale nei prossimi dieci anni".

Ma il vero ostacolo, secondo i fautori di questi sistemi, non è la tecnologia. È l'elemento umano. "Un milione di droni è fantastico, ma avrai bisogno di un milione di persone", osserva Richard Drake di Anduril Europe. La sua soluzione? Eliminare le persone dall'equazione. "La catena di uccisione in un sistema come ASGARD può essere completamente autonoma", afferma senza esitazioni.

L'Italia nella corsa agli armamenti autonomi

Anche l'Italia è protagonista di questa corsa verso l'automazione bellica. Nel marzo 2025, Leonardo, il colosso della difesa italiano, ha siglato una partnership strategica con l'azienda turca Baykar per creare una joint venture dedicata allo sviluppo di droni autonomi. La nuova società, con sede in Italia e produzione presso gli stabilimenti Piaggio acquisiti da Baykar, punta a equipaggiare i droni TB2 e Akinci con sensori avanzati, radar di nuova generazione e sistemi di intelligenza artificiale sviluppati da Leonardo.

Roberto Cingolani, amministratore delegato di Leonardo, ha dichiarato che l'accordo risponde alla necessità di affrontare sfide come l'intelligenza artificiale, i caccia di sesta generazione, la cybersicurezza e lo spazio. Il mercato europeo per droni da combattimento, sorveglianza armata e attacco profondo è stimato in circa 100 miliardi di dollari nel prossimo decennio.

Al centro della strategia tecnologica c'è l'implementazione di sistemi di collaborazione tra piloti umani e algoritmi di intelligenza artificiale, una frontiera dell'aviazione militare che consente l'interazione tra uomini e macchine. La partnership mira anche a sviluppare capacità di impiego in sciame, attraverso algoritmi distribuiti che consentono a decine di piattaforme senza pilota di operare in coordinamento autonomo, adattandosi dinamicamente ai cambiamenti della situazione tattica.

Parallelamente, Leonardo investe nella ricerca attraverso il "Drone Contest", una competizione annuale che coinvolge sette università italiane nello sviluppo di soluzioni di intelligenza artificiale applicate a sistemi senza pilota. L'iniziativa punta a sviluppare droni autonomi capaci di muoversi in ambienti sconosciuti senza segnale GPS, elaborando dati in tempo reale attraverso algoritmi di AI. Si tratta di tecnologie che potrebbero anchetrovare applicazioni in contesti complessi come l'ispezione di aree colpite da disastri naturali, ma inevitabilmente hanno anche applicazioni militari, ed è evidente la strategia di Leonardo

L'Italia partecipa inoltre al programma europeo GCAP (Global Combat Air Programme) insieme a Regno Unito e Giappone per lo sviluppo di caccia di sesta generazione dotati di capacità completamente digitali. L'aereo sarà in grado di condurre missioni con altri asset in modo coordinato e collaborativo, aiutato da un'infrastruttura di comando, controllo e comunicazioni basata su intelligenza artificiale, supercomputing, architettura cloud di combattimento e collegamenti dati ultra-veloci e cyber-resilienti.

La disumanizzazione della guerra

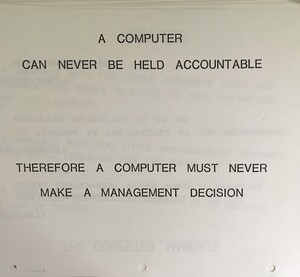

Qui si trova il cuore del problema etico che come pacifisti denunciamo da anni. Delegare a un algoritmo la decisione su chi deve vivere e chi deve morire rappresenta un salto di qualità nella disumanizzazione della guerra che l'umanità non aveva mai osato compiere prima.

Come ha avvertito il ministro degli esteri austriaco Alexander Schallenberg, "questo è il momento Oppenheimer della nostra generazione". Proprio come le armi nucleari hanno ridefinito la guerra nel ventesimo secolo, le armi autonome guidate dall'intelligenza artificiale stanno rimodellando i campi di battaglia del ventunesimo. Con una differenza cruciale: mentre le armi nucleari hanno reso la guerra totale così terrificante da scoraggiarla, i sistemi autonomi rischiano di rendere l'uccisione di massa un processo meccanizzato e quasi privo di sforzo.

I dati dal conflitto russo-ucraino sono già eloquenti: i droni rappresentano il 70-80% delle vittime sul campo di battaglia. La guerra è già diventata in gran parte una questione di macchine contro macchine, con esseri umani ridotti a bersagli o danni collaterali.

Le illusioni della deterrenza tecnologica

I sostenitori di questi sistemi li presentano come strumenti di deterrenza. L'idea è che mostrare capacità di distruzione massiccia possa prevenire i conflitti. Ma la storia insegna che la corsa agli armamenti ha sempre prodotto esattamente l'effetto opposto: escalation, instabilità e, infine, guerra.

Cosa accade quando entrambe le parti possiedono tali capacità? Quando algoritmi si confrontano con algoritmi in una corsa alla velocità dove il fattore umano - il giudizio, l'esitazione, la compassione - è visto come un ostacolo da eliminare? Le dichiarazioni di Selçuk Bayraktar, secondo cui "l'intelligenza artificiale e la potenza di calcolo moderna consentono ai droni di prendere decisioni in tempo reale, con una rapidità impossibile per un pilota umano", rivelano una filosofia in cui la velocità della macchina viene considerata superiore alla riflessione umana.

Il problema della responsabilità

Mary Wareham, direttrice della divisione armamenti di Human Rights Watch, documenta come diversi paesi con risorse importanti stiano investendo pesantemente nell'intelligenza artificiale e tecnologie correlate per sviluppare sistemi d'arma autonomi terrestri, marittimi e aerei. Gli Stati Uniti sono in testa a questa corsa, ma anche Russia, Cina, Israele e Corea del Sud stanno investendo massicciamente in queste tecnologie. E ora anche l'Europa, con l'Italia in prima linea, si sta unendo a questa competizione.

La mobilitazione internazionale

Di fronte a questa deriva, la società civile internazionale si è organizzata. La campagna Stop Killer Robots, una coalizione di oltre 270 organizzazioni non governative in 70 paesi, lavora dal 2012 per ottenere un nuovo trattato internazionale che proibisca e regoli i sistemi d'arma autonomi. Il loro obiettivo è garantire un controllo umano significativo sull'uso della forza e contrastare quella che definiscono "disumanizzazione digitale", ovvero il processo attraverso cui gli esseri umani vengono ridotti a dati che vengono poi utilizzati per prendere decisioni che influenzano negativamente le loro vite.

I risultati di questa mobilitazione cominciano a vedersi. Nel dicembre 2023, 152 paesi hanno votato a favore della prima risoluzione dell'Assemblea Generale delle Nazioni Unite sui "killer robots", mentre solo quattro paesi hanno votato contro e undici si sono astenuti. La risoluzione riconosce le "serie sfide e preoccupazioni" sollevate dalle nuove applicazioni tecnologiche nel dominio militare, in particolare quelle relative all'intelligenza artificiale e all'autonomia nei sistemi d'arma. Più di 120 paesi oggi considerano necessario (tra cui l’Italia), urgente e fattibile un nuovo trattato sui sistemi d'arma autonomi con divieti e restrizioni.

Nonostante il crescente consenso internazionale, la strada verso un trattato vincolante è irta di ostacoli. I paesi hanno discusso i sistemi d'arma letali autonomi nelle riunioni della Convenzione sulle Armi Convenzionali a Ginevra dal 2014, ma senza risultati sostanziali. Il progresso è stato ostacolato dall'approccio decisionale basato sul consenso della convenzione, che significa che un singolo paese può bloccare o respingere una proposta su cui tutti gli altri paesi sono d'accordo.

Una manciata di grandi potenze militari che investono in sistemi d'arma autonomi - in particolare India, Israele, Russia e Stati Uniti - hanno sfruttato questo processo per bloccare ripetutamente le proposte di negoziare uno strumento giuridicamente vincolante. L'Assemblea Generale delle Nazioni Unite, tuttavia, fornisce un forum più inclusivo che consente una considerazione più approfondita delle preoccupazioni relative ai diritti umani, all'etica, alla sicurezza e ad altre questioni sollevate dai sistemi d'arma autonomi.

Nel maggio 2025 si è tenuta la prima riunione dell'Assemblea Generale delle Nazioni Unite sui sistemi d'arma autonomi, con la partecipazione di funzionari di 96 paesi, oltre a rappresentanti di agenzie ONU, della ICRC e di organizzazioni non governative. Dozzine di stati hanno espresso gravi preoccupazioni e allarme per la rimozione del controllo umano dai sistemi d'arma. La maggior parte ha chiesto un nuovo trattato internazionale per affrontare queste preoccupazioni, con molti che sostengono un rigoroso divieto sui sistemi d'arma autonomi imprevedibili.

Invece di investire miliardi in sistemi sempre più letali - come i 100 miliardi di dollari che l'industria europea della difesa prevede di spendere nel prossimo decennio solo per i droni - l'Europa dovrebbe sostenere un trattato internazionale vincolante che vieti lo sviluppo e l'uso di sistemi d'arma completamente autonomi, mantenendo sempre un controllo umano significativo sulle decisioni letali. Quegli stessi miliardi potrebbero finanziare diplomazia, sviluppo economico, cooperazione internazionale. La vera sicurezza non si costruisce con la minaccia della distruzione automatizzata, ma con la fiducia reciproca. La deterrenza basata sulla promessa di "hellscape" non crea stabilità, crea terrore reciproco e aumenta la probabilità di errori catastrofici. Preservare l'elemento umano nella guerra non è una debolezza, ma un necessario freno morale.

Come ha osservato Nicole Van Rooijen, direttrice esecutiva di Stop Killer Robots, l'uso diffuso di armi autonome rappresenterebbe un "fallimento morale". La velocità con cui la tecnologia sta avanzando, e le prove che i sistemi di puntamento abilitati all'AI vengono già utilizzati sul campo di battaglia, aggiungono urgenza alle richieste di norme internazionali sulla tecnologia.

Mentre 152 paesi hanno già votato contro questa deriva alle Nazioni Unite, e mentre organizzazioni come la Croce Rossa Internazionale e centinaia di ONG in tutto il mondo chiedono con forza un trattato vincolante, l'industria militare - italiana ed europea - continua a correre verso l'automazione totale della guerra. La posta in gioco non potrebbe essere più alta: si tratta di decidere se vogliamo un futuro in cui le macchine decidono chi deve vivere e chi deve morire, oppure se vogliamo preservare un irriducibile nucleo di umanità.

Articoli correlati

Il dibattito e le prospettive per i negoziati di pace

Il dibattito e le prospettive per i negoziati di paceGli errori di calcolo della Nato nella guerra in Ucraina

L'Occidente sta perdendo la sua scommessa. Aveva ipotizzato - nella seconda metà del 2022 e con la controffensiva del 2023 - una sconfitta della Russia e una vittoria dell'Ucraina, con riconquista non solo del Donbass ma anche della Crimea. E adesso non sa che fare.25 febbraio 2026 - Redazione PeaceLink Ucraina, comincia il quinto anno di guerra

Ucraina, comincia il quinto anno di guerra"L'UE tace sugli obiettori di coscienza ucraini"

Organizzazioni come l'European Bureau for Conscientious Objection (EBCO) e International Fellowship of Reconciliation accusano l'UE di silenzio selettivo, chiedendo asilo per obiettori ucraini e ricordando che la Carta dei Diritti Fondamentali dell'UE (art. 10) garantisce la libertà di coscienza.24 febbraio 2026 - Redazione PeaceLink Menzogne di guerra

Menzogne di guerraCome manipolano l’opinione pubblica

E' fondamentale smontare la propaganda bellica che sta costruendo allarmi per creare un clima di paura e di scivolamento verso l'escalation militare. In allegato a questa pagina web vi sono le slide sull'allarme "droni" sull'Europa e sui presunti sconfinamenti russi.Redazione PeaceLink Una sintesi delle news tratte da Sociale.network e da PeaceLink

Una sintesi delle news tratte da Sociale.network e da PeaceLinkAlbert: il bollettino pacifista generato con l'IA di Open Notebook

Una sintesi di ciò che è stato fatto negli ultimi mesi. Il bollettino è stato realizzato con il software di Intelligenza Artificiale Generativa Open Notebook installato sul sito di PeaceLink. E' la prima esperienza di generazione di testi per la pace tramite piattaforma IA no profit.10 febbraio 2026 - Redazione PeaceLink

Sociale.network